Herramientas

Explore herramientas para respaldar y acelerar los flujos de trabajo de TensorFlow.

Colaboratory es un entorno de notebook Jupyter gratuito que no requiere configuración y se ejecuta completamente en la nube, lo que le permite ejecutar código TensorFlow en su navegador con un solo clic.

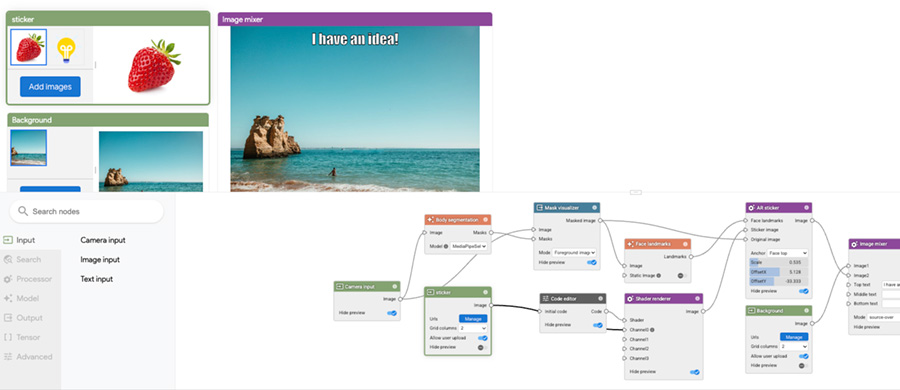

Un marco web de codificación visual para crear prototipos de flujos de trabajo de aprendizaje automático utilizando dispositivos de E/S, modelos, aumento de datos e incluso código Colab como bloques de construcción reutilizables.

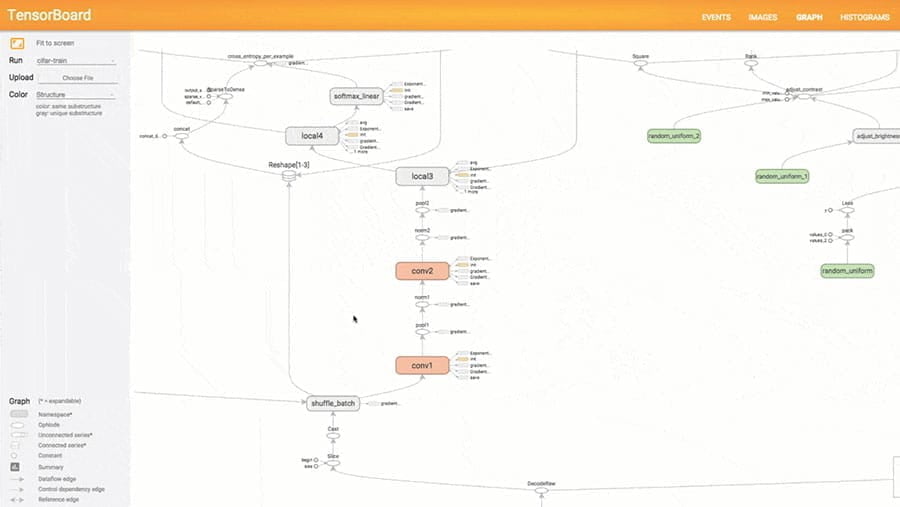

Un conjunto de herramientas de visualización para comprender, depurar y optimizar programas de TensorFlow.

Una herramienta para sondear modelos de aprendizaje automático sin código, útil para la comprensión, la depuración y la equidad de los modelos. Disponible en cuadernos TensorBoard y jupyter o colab.

Un amplio conjunto de pruebas de aprendizaje automático para medir el rendimiento de los marcos de software de aprendizaje automático, los aceleradores de hardware de aprendizaje automático y las plataformas en la nube de aprendizaje automático.

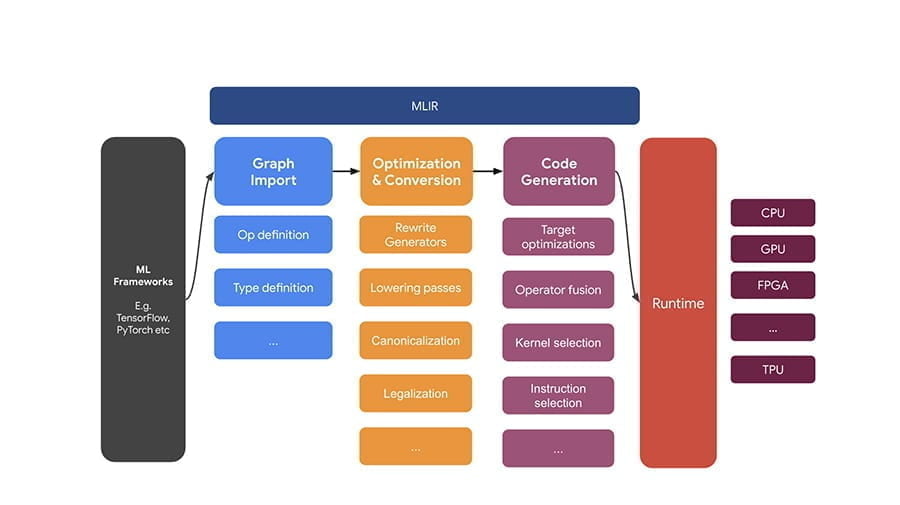

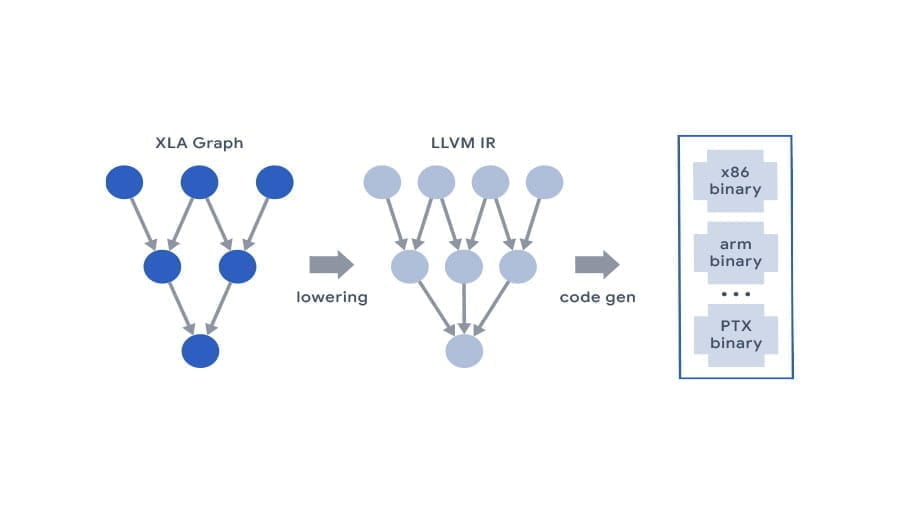

XLA (Álgebra lineal acelerada) es un compilador de dominio específico para álgebra lineal que optimiza los cálculos de TensorFlow. Los resultados son mejoras en la velocidad, el uso de la memoria y la portabilidad en plataformas móviles y de servidor.

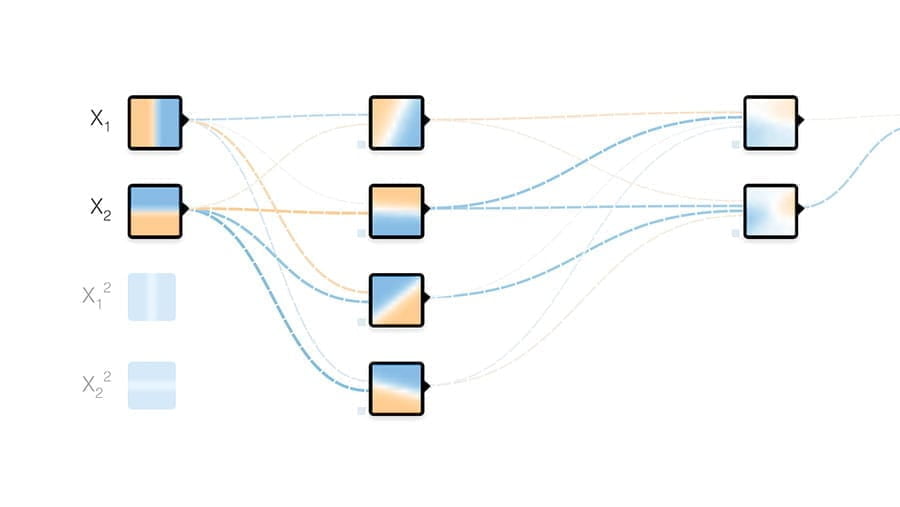

Juega con una red neuronal en tu navegador. No te preocupes, no puedes romperlo.

El programa TPU Research Cloud (TRC) permite a los investigadores solicitar acceso a un grupo de más de 1000 Cloud TPU sin costo alguno para ayudarlos a acelerar la próxima ola de avances en investigación.