أدوات

اكتشف الأدوات اللازمة لدعم وتسريع سير عمل TensorFlow.

Colaboratory هي بيئة Jupyter Notebook مجانية لا تتطلب أي إعداد ويتم تشغيلها بالكامل في السحابة، مما يسمح لك بتنفيذ تعليمات TensorFlow البرمجية في متصفحك بنقرة واحدة.

إطار عمل ويب للترميز المرئي لإنشاء نماذج أولية لسير عمل تعلم الآلة باستخدام أجهزة الإدخال/الإخراج والنماذج وزيادة البيانات وحتى كود Colab كوحدات بناء قابلة لإعادة الاستخدام.

مجموعة من أدوات التصور لفهم برامج TensorFlow وتصحيح أخطائها وتحسينها.

أداة لفحص نماذج التعلم الآلي بدون تعليمات برمجية، وهي مفيدة لفهم النماذج وتصحيح الأخطاء والإنصاف. متوفر في أجهزة الكمبيوتر المحمولة TensorBoard وjupyter أو colab.

مجموعة معايير ML واسعة النطاق لقياس أداء أطر عمل برامج ML، ومسرعات أجهزة ML، والأنظمة الأساسية السحابية لتعلم الآلة.

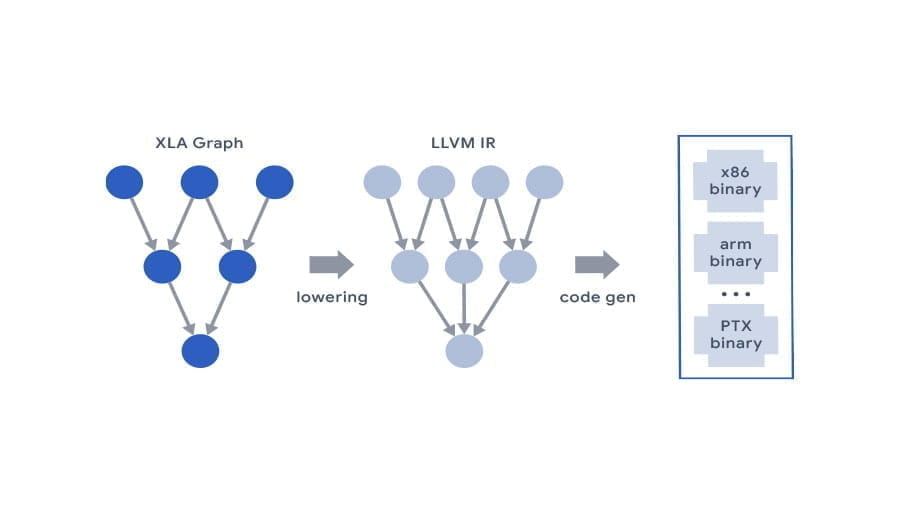

XLA (الجبر الخطي المتسارع) هو مترجم خاص بالمجال للجبر الخطي الذي يعمل على تحسين حسابات TensorFlow. وكانت النتائج تحسينات في السرعة واستخدام الذاكرة وإمكانية النقل على منصات الخادم والمحمول.

يمكّن برنامج TPU Research Cloud (TRC) الباحثين من التقدم بطلب للوصول إلى مجموعة تضم أكثر من 1000 Cloud TPUs مجانًا لمساعدتهم على تسريع الموجة التالية من الإنجازات البحثية.