Narzędzia

Poznaj narzędzia wspierające i przyspieszające przepływy pracy TensorFlow.

Colaboratory to bezpłatne środowisko notebooków Jupyter, które nie wymaga konfiguracji i działa całkowicie w chmurze, umożliwiając wykonanie kodu TensorFlow w przeglądarce za pomocą jednego kliknięcia.

Wizualna platforma internetowa do kodowania umożliwiająca prototypowanie przepływów pracy ML przy użyciu urządzeń we/wy, modeli, powiększania danych, a nawet kodu Colab jako elementów składowych wielokrotnego użytku.

Zestaw narzędzi do wizualizacji umożliwiający zrozumienie, debugowanie i optymalizację programów TensorFlow.

Narzędzie do bezkodowego sondowania modeli uczenia maszynowego, przydatne do zrozumienia modelu, debugowania i zapewnienia uczciwości. Dostępne w notesach TensorBoard i jupyter lub colab.

Szeroki zestaw testów porównawczych ML do pomiaru wydajności platform oprogramowania ML, akceleratorów sprzętowych ML i platform chmurowych ML.

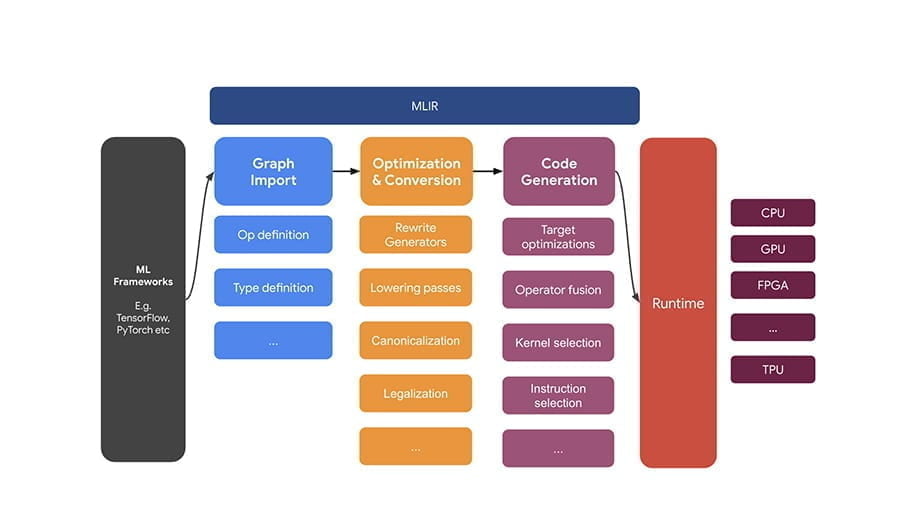

XLA (Accelerated Linear Algebra) to specyficzny dla domeny kompilator algebry liniowej, który optymalizuje obliczenia TensorFlow. Rezultatem jest poprawa szybkości, wykorzystania pamięci i przenośności na platformach serwerowych i mobilnych.

Majsterkuj przy sieci neuronowej w przeglądarce. Nie martw się, nie możesz tego złamać.

Program TPU Research Cloud (TRC) umożliwia naukowcom ubieganie się o dostęp do klastra ponad 1000 jednostek Cloud TPU bezpłatnie, co pomoże im przyspieszyć kolejną falę przełomowych odkryć badawczych.