- 説明:

CIFAR-10 のテスト セットのラベルを変更したバージョンで、実際の人間のアノテーターによるソフトラベルが付けられています。元の CIFAR-10 テスト セット内のすべてのペア (画像、ラベル) に対して、平均的なソフト ラベルに加えて、実際の人間のアノテーターによって与えられたいくつかの追加ラベルが提供されます。トレーニング セットは元のデータセットと同一です。

バージョン:

-

1.0.0(デフォルト): 初期リリース。

-

ダウンロードサイズ:

172.92 MiBデータセットのサイズ:

144.85 MiB自動キャッシュ(ドキュメント): はい

分割:

| スプリット | 例 |

|---|---|

'test' | 10,000 |

'train' | 50,000 |

- 機能の構造:

FeaturesDict({

'annotator_ids': Sequence(Scalar(shape=(), dtype=int32)),

'human_labels': Sequence(ClassLabel(shape=(), dtype=int64, num_classes=10)),

'id': Text(shape=(), dtype=string),

'image': Image(shape=(32, 32, 3), dtype=uint8),

'label': ClassLabel(shape=(), dtype=int64, num_classes=10),

'reaction_times': Sequence(Scalar(shape=(), dtype=float32)),

'soft_label': Tensor(shape=(10,), dtype=float32),

'trial_indices': Sequence(Scalar(shape=(), dtype=int32)),

})

- 機能ドキュメント:

| 特徴 | クラス | 形 | Dタイプ | 説明 |

|---|---|---|---|---|

| 特徴辞書 | ||||

| annotator_ids | シーケンス(スカラー) | (なし、) | int32 | |

| 人間のラベル | シーケンス(クラスラベル) | (なし、) | int64 | |

| ID | 文章 | 弦 | ||

| 画像 | 画像 | (32、32、3) | uint8 | |

| ラベル | クラスラベル | int64 | ||

| 反応時間 | シーケンス(スカラー) | (なし、) | float32 | |

| ソフトラベル | テンソル | (10,) | float32 | |

| トライアルインデックス | シーケンス(スカラー) | (なし、) | int32 |

監視キー(

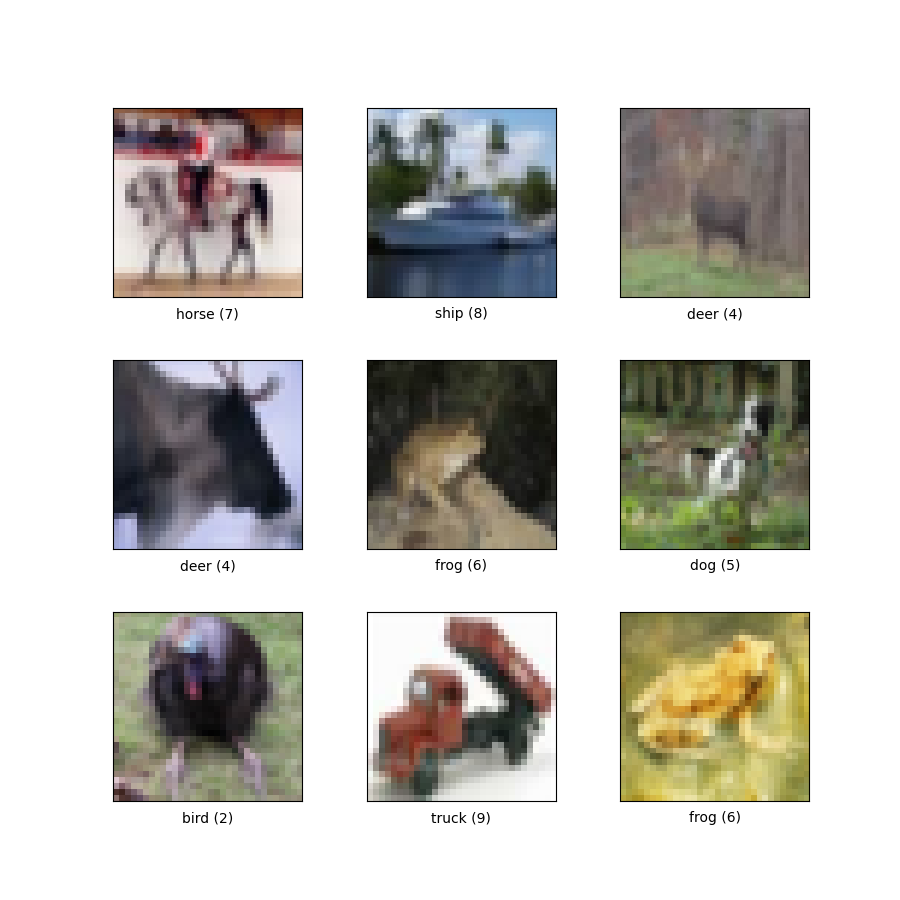

as_superviseddocを参照):None図( tfds.show_examples ):

- 例( tfds.as_dataframe ):

- 引用:

@inproceedings{wei2022learning,

title={Human uncertainty makes classification more robust},

author={Joshua C. Peterson and Ruairidh M. Battleday and Thomas L. Griffiths

and Olga Russakovsky},

booktitle={IEEE International Conference on Computer Vision and Pattern

Recognition (CVPR)},

year={2019}

}