- 説明:

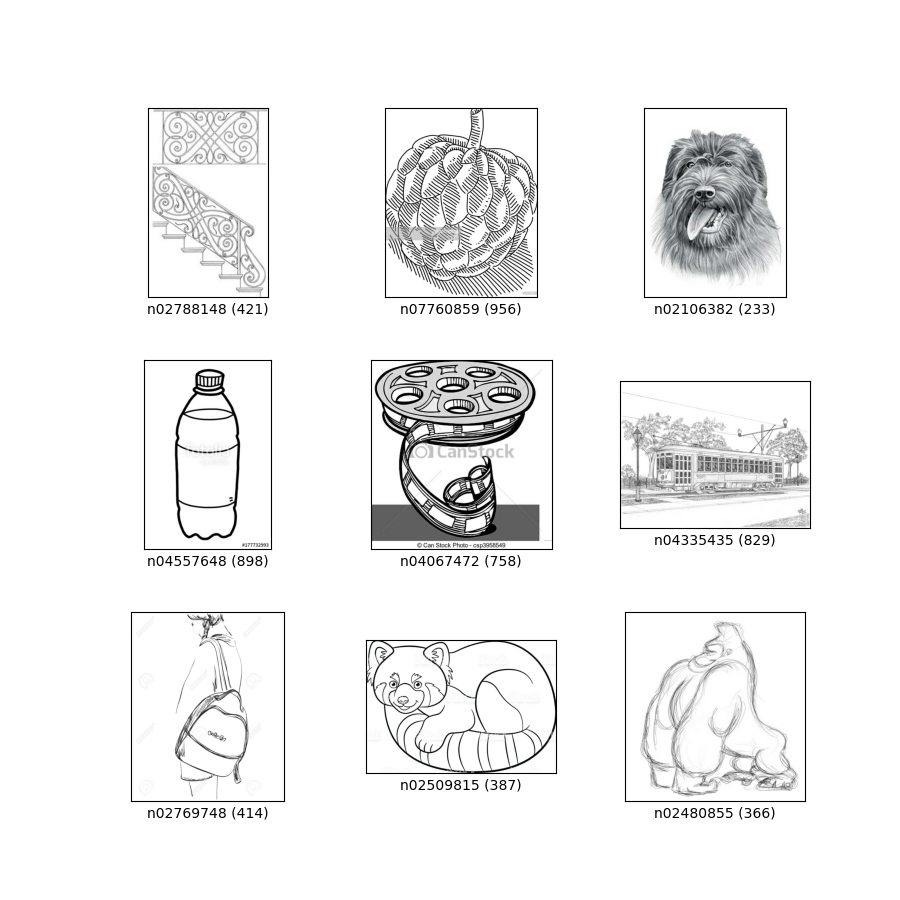

ImageNet-Sketch は、1000 個の ImageNet クラスごとに 50 個ずつ、50,889 個の白黒のスケッチ イメージで構成されています。これらの画像は、もともと Google 画像検索から「__ のスケッチ」で収集されたものです。 100 枚の画像が収集され、手動でフィルター処理されました。良好な画像が 50 未満のクラスでは、反転または回転によって追加の画像が作成されました。

追加のドキュメント:コードを使用したペーパーの探索

バージョン:

-

1.0.0(デフォルト): 初期リリース。

-

ダウンロードサイズ:

7.07 GiBデータセットサイズ:

7.61 GiB自動キャッシュ(ドキュメント): いいえ

スプリット:

| スプリット | 例 |

|---|---|

'test' | 50,889 |

- 機能構造:

FeaturesDict({

'file_name': Text(shape=(), dtype=string),

'image': Image(shape=(None, None, 3), dtype=uint8),

'label': ClassLabel(shape=(), dtype=int64, num_classes=1000),

})

- 機能のドキュメント:

| 特徴 | クラス | 形 | Dtype | 説明 |

|---|---|---|---|---|

| 特徴辞書 | ||||

| ファイル名 | 文章 | ストリング | ||

| 画像 | 画像 | (なし、なし、3) | uint8 | |

| ラベル | クラスラベル | int64 |

監視されたキー(

as_superviseddocを参照):('image', 'label')図( tfds.show_examples ):

- 例( tfds.as_dataframe ):

- 引用:

@inproceedings{wang2019learning,

title={Learning Robust Global Representations by Penalizing Local Predictive Power},

author={Wang, Haohan and Ge, Songwei and Lipton, Zachary and Xing, Eric P},

booktitle={Advances in Neural Information Processing Systems},

pages={10506--10518},

year={2019}

}