- 説明:

Places365-Standard データセットには、Places365 CNN のトレーニングに使用される 365 のシーン カテゴリからの 180 万の列車画像が含まれています。検証セットにはカテゴリごとに 50 個の画像があり、テスト セットにはカテゴリごとに 900 個の画像があります。

追加ドキュメント:コード付きの論文について調べる

ホームページ: http://places2.csail.mit.edu/

バージョン:

-

2.1.0(デフォルト): KYD との統合を容易にするためにサンプルキーを変更しました。

-

ダウンロードサイズ:

29.27 GiBデータセットのサイズ:

27.85 GiB自動キャッシュ(ドキュメント): いいえ

分割:

| スプリット | 例 |

|---|---|

'test' | 328,500 |

'train' | 1,803,460 |

'validation' | 36,500 |

- 機能の構造:

FeaturesDict({

'filename': Text(shape=(), dtype=string),

'image': Image(shape=(256, 256, 3), dtype=uint8),

'label': ClassLabel(shape=(), dtype=int64, num_classes=365),

})

- 機能ドキュメント:

| 特徴 | クラス | 形 | Dタイプ | 説明 |

|---|---|---|---|---|

| 特徴辞書 | ||||

| ファイル名 | 文章 | 弦 | ||

| 画像 | 画像 | (256, 256, 3) | uint8 | |

| ラベル | クラスラベル | int64 |

監視キー(

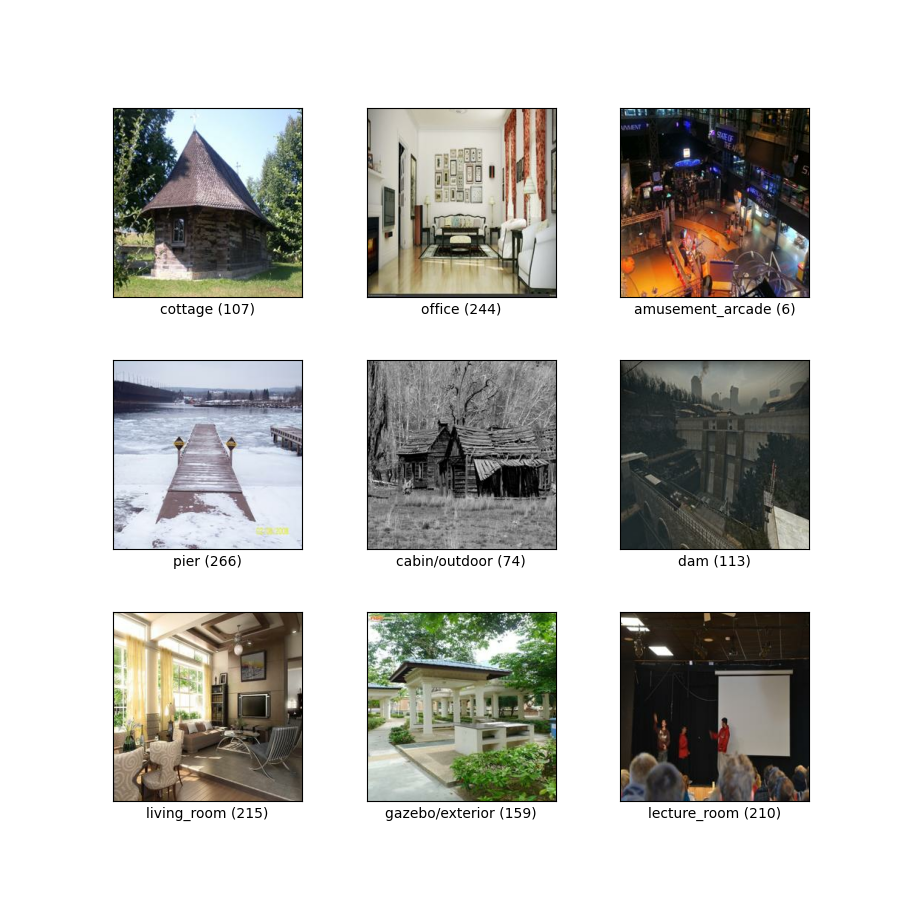

as_superviseddocを参照):('image', 'label', 'filename')図( tfds.show_examples ):

- 例( tfds.as_dataframe ):

- 引用:

@article{zhou2017places,

title={Places: A 10 million Image Database for Scene Recognition},

author={Zhou, Bolei and Lapedriza, Agata and Khosla, Aditya and Oliva, Aude and Torralba, Antonio},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence},

year={2017},

publisher={IEEE}

}