- Descripción :

El conjunto de datos de Places está diseñado siguiendo los principios de la cognición visual humana. Nuestro objetivo es construir un núcleo de conocimiento visual que pueda usarse para entrenar sistemas artificiales para tareas de comprensión visual de alto nivel, como el contexto de la escena, el reconocimiento de objetos, la predicción de acciones y eventos, y la inferencia de la teoría de la mente.

Las categorías semánticas de Lugares se definen por su función: las etiquetas representan el nivel de entrada de un entorno. Para ilustrar, el conjunto de datos tiene diferentes categorías de habitaciones, o calles, etc., ya que uno no actúa de la misma manera y no hace las mismas predicciones de lo que puede suceder a continuación, en una habitación de casa, una habitación de hotel o una guardería. En total, Places contiene más de 10 millones de imágenes que comprenden más de 400 categorías de escenas únicas. El conjunto de datos presenta de 5000 a 30 000 imágenes de entrenamiento por clase, de acuerdo con las frecuencias de ocurrencia del mundo real. Mediante el uso de redes neuronales convolucionales (CNN), el conjunto de datos de Places permite el aprendizaje de características profundas de la escena para varias tareas de reconocimiento de escena, con el objetivo de establecer nuevas actuaciones de vanguardia en puntos de referencia centrados en la escena.

Aquí proporcionamos la base de datos de lugares y las CNN capacitadas para fines académicos de investigación y educación.

Página de inicio: http://places2.csail.mit.edu/

Código fuente :

tfds.datasets.placesfull.BuilderVersiones :

-

1.0.0(predeterminado): Sin notas de la versión.

-

Tamaño de descarga :

143.56 GiBTamaño del conjunto de datos :

136.56 GiBAlmacenamiento automático en caché ( documentación ): No

Divisiones :

| Separar | Ejemplos |

|---|---|

'train' | 10,653,087 |

- Estructura de características :

FeaturesDict({

'filename': Text(shape=(), dtype=string),

'image': Image(shape=(256, 256, 3), dtype=uint8),

'label': ClassLabel(shape=(), dtype=int64, num_classes=435),

})

- Documentación de características :

| Rasgo | Clase | Forma | Tipo D | Descripción |

|---|---|---|---|---|

| CaracterísticasDict | ||||

| Nombre del archivo | Texto | cuerda | ||

| imagen | Imagen | (256, 256, 3) | uint8 | |

| etiqueta | Etiqueta de clase | int64 |

Claves supervisadas (ver

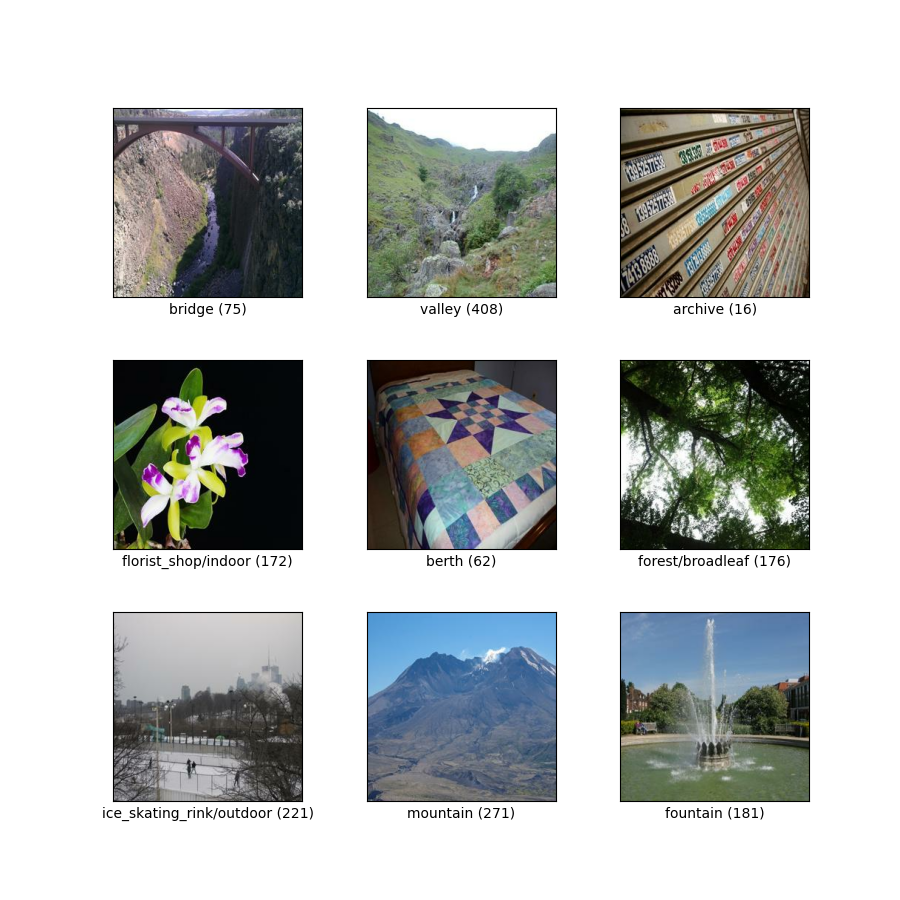

as_supervised):('image', 'label', 'filename')Figura ( tfds.show_examples ):

- Ejemplos ( tfds.as_dataframe ):

- Cita :

@article{zhou2017places,

title={Places: A 10 million Image Database for Scene Recognition},

author={Zhou, Bolei and Lapedriza, Agata and Khosla, Aditya and Oliva, Aude and Torralba, Antonio},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence},

year={2017},

publisher={IEEE}

}